El desarrollo acelerado de nuevas tecnologías digitales plantea dudas y preocupación ética de la IA en torno a su implementación: la privacidad, la formación de la propia identidad, la atribución de responsabilidad o los sesgos en el procesamiento de datos

La IA en los negocios

La aplicación de la IA como herramienta de resolución de problemas ofrece una gran promesa de avance. La IA en medicina por ejemplo, podría revertir los elevados costos médicos. La IA en la agricultura podría conducir a duplicar o triplicar los rendimientos de los cultivos a partir de los insumos de hoy, un logro fundamental en la lucha continua contra la inseguridad de la oferta alimentaria.

Pero la IA también puede ser utilizada contra nuestros intereses humanos a través de medios tales como ataques cibernéticos, manipulación social o discriminación, e incentivos financieros. Al darse cuenta de esto, los consumidores y los ciudadanos están preocupados por la acumulación de datos que se utilizan para tomar decisiones sin el consentimiento del consumidor o el respeto de los derechos del consumidor. Nuevas leyes como la europea

En una encuesta de Deloitte el 76 por ciento de los ejecutivos que respondieron dijeron que esperaban que la IA «transformara sustancialmente» sus empresas dentro de los próximos tres años. Alrededor de un tercio de este grupo agregó que los riesgos éticos eran una preocupación principal sobre la tecnología de IA.

IA y 4 categorias

La inteligencia artificial está compuesta de una gran variedad de artefactos e instrumentos interconectados que recogen cantidades enormes de información; procesa, cruza y reutiliza este gran número de datos mediante algoritmos, unas listas de instrucciones de tamaño variable que pueden emplearse para resolver problemas, buscar conexiones y alcanzar decisiones. Así, un tratamiento correcto y respetuoso de los datos que maneja la IA ofrece oportunidades para la investigación biomédica, la salud pública, la gestión administrativa, los servicios sociales, la atención a colectivos desfavorecidos, el desarrollo económico, la innovación social, el tratamiento de residuos, la contaminación ambiental, la educación, el transporte o la agricultura y la industria.

IA es un término amplio que abarca tecnologías que pueden imitar el comportamiento humano inteligente. Actualmente, se utilizan en general cuatro categorías principales de IA:

• Aprendizaje automático, capacidad de los modelos estadísticos para desarrollar aptitudes y mejorar su rendimiento a lo largo del tiempo sin la necesidad de seguir instrucciones explícitamente programadas.

• Aprendizaje profundo, forma compleja de aprendizaje automático utilizada para el reconocimiento de imagen y de voz que involucra redes neuronales con muchas capas de variables abstractas.

• Procesamiento del lenguaje natural (PNL), tecnología que impulsa interfaces basadas en voz para asistentes virtuales y chatbots, así como para consultar conjuntos de datos, extrayendo o generando significado e intención del texto en una forma legible, estilísticamente neutral y gramaticalmente correcta.

• Visión por computador, tecnología que extrae el significado y la intención de los elementos visuales, ya sean personajes (en el caso de la digitalización de documentos) o la categorización de contenido en imágenes como caras, objetos, escenas y actividades.

Consideraciones éticas de la IA

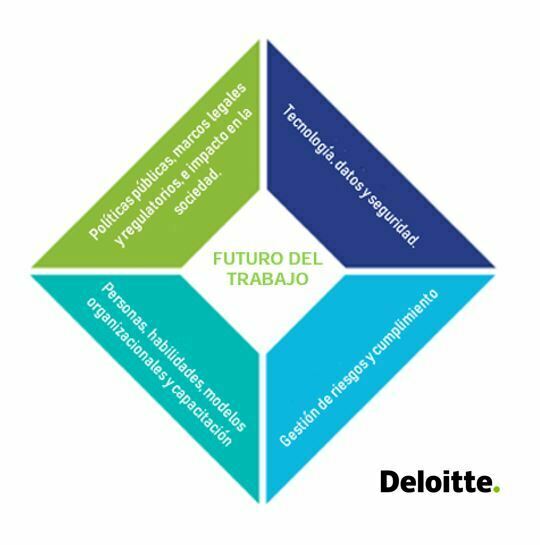

Una solución de ética de la IA con un propósito ético puede incluir procesos que carecen de integridad o precisión hacia este fin ético. Para comprender dónde podrían surgir problemas éticos y cómo en el futuro del trabajo podrían evitarse esos problemas, es útil organizar la ética de la IA a lo largo de cuatro dimensiones principales de preocupación.

Dimensiones de preopupacion ética de la IA

Gestión de riesgos y cumplimiento. Descubra cómo la organización desarrolla y aplica políticas, procedimientos y estándares para soluciones de IA. Vea cómo se relacionan con la misión, los objetivos y los requisitos legales o regulatorios de la organización. Los jefes de riesgo, cumplimiento, legal y ética juegan un papel en esta dimensión.

Tecnología, datos y seguridad. Observe el enfoque de la organización para el ciclo de vida de la IA desde una perspectiva ética, incluidas las formas en que construye y prueba datos y modelos en soluciones habilitadas para la IA. El liderazgo en esta dimensión proviene de la organización, jefes de información, tecnología, datos, seguridad y privacidad.

Personas, habilidades, modelos organizacionales y capacitación. Comprenda y monitoree cómo el uso de la IA afecta las experiencias de empleados y clientes. Evaluar continuamente cómo los modelos operativos, los roles y los modelos organizacionales están evolucionando debido al uso de IA. Eduque a todos los niveles de la fuerza laboral e implemente iniciativas de capacitación para actualizar o mejorar las capacidades. Establecer protocolos para incentivar el comportamiento ético y alentar decisiones éticas a lo largo del ciclo de vida de la IA. En esta dimensión, la función de recursos humanos comparte la responsabilidad con los equipos de aprendizaje y desarrollo, los oficiales de ética y el liderazgo ejecutivo más amplio.

Políticas públicas, marcos legales y regulatorios, e impacto en la sociedad. Finalmente, desarrolle un sentido del lugar de la IA en el entorno empresarial. Esto incluye el nivel de aceptación que la IA tiene en el gobierno y la cultura. También incluye la dirección que las leyes y las regulaciones están tomando con respecto a la IA. Aplique esta información al efecto que la IA pueda tener en el tiempo en términos de educación, empleo, ingresos, cultura y otros aspectos de la sociedad. El CEO, CRO, CCO y CFO tienen roles de liderazgo en las tres primeras dimensiones, mientras que la cuarta dimensión se basa en el liderazgo de la política pública, los organismos de formulación de políticas.

Formacion en la etica de la IA

Urge pensar sobre nuestra convivencia con las nuevas tecnologías y sobre la ética de la IA. La práctica del uso de una tecnología está estrechamente relacionada con los principios éticos que incorpora y es la condición básica para su apropiación y aceptación por parte de la comunidad, lo que contribuirá al empoderamiento tecnológico de la ciudadanía.

Por este motivo la Empower Talent junto con la UCM han desarrollado un Titulo Experto en IA En las Ciencias Sociales & Jurídicas que aborda

la aplicación de la ética de la IA y uso generalizado de algoritmos y sistemas que incorporan Inteligencia Artificial (IA) en la economía, la cultura, la sociedad y la política afecta a los ciudadanos en sus derechos personales.

Procesamiento del lenguaje natural: ¿qué es?

El objetivo del PLN es permitir que las computadoras procesen y analicen grandes cantidades de datos de lenguaje natural, para realizar tareas como traducción automática, reconocimiento de voz y generación de texto.

Qué es el metaverso, sus características y cómo funciona

El metaverso es un mundo virtual donde las personas interactúan. Descubre sus características, funcionamiento y cómo aprovecharlo

Por qué Estudiar un Máster en Medios Digitales y Tecnología

En la era digital actual, donde la tecnología y los medios digitales evolucionan a un ritmo sin precedentes, la educación se convierte en una herramienta crucial para quienes desean destacar y liderar en el sector

Machine Learning en Madrid

Conecta con la Innovación y el Éxito La Vanguardia del Machine Learning en Madrid El campo del machine learning, o aprendizaje automático, se ha convertido